2026年技术演进趋势:AI编程成本大幅优化与算力调度策略

回顾过去几年,开发者在构建AIAgent时最头疼的问题莫过于算力成本。记得在2024年初,调用一次复杂Agent的开销往往令人望而却步,那时的我们还在通过各种手段精简Prompt以节省Tokens。然而,随着模型能力的迭代,算力消耗呈指数级增长,单一Agent的资源需求甚至达到传统Chatbot的千倍规模。这不仅仅是技术挑战,更是商业落地的痛点。

问:为什么开发者现在开始关注订阅制而非单纯的按量付费?答:因为可预测性。当业务规模化后,按量计费的波动性极高,而类似于阿里云CodingPlan这样的订阅方案,通过固定额度提供高频次调用,实际上将不确定性转化为稳定的运营成本。

深度剖析:模型切换的架构灵活性

在当前多模型并存的生态中,锁定单一模型往往意味着技术债务。阿里云CodingPlan引入Qwen3.5-Plus、Qwen3-Coder-Next等模型矩阵,其实质是提供了一套兼容性极强的中间层。开发者无需重构代码库,即可根据任务复杂度动态切换底层模型,这种灵活性是企业级应用的核心诉求。

对于前端开发者而言,这意味着在处理UI逻辑时可以使用轻量级模型,而在进行复杂后端重构时,则能一键调用逻辑推理能力更强的模型。这种无缝切换机制,最大限度地减少了环境迁移成本,让开发工作流更加顺滑。

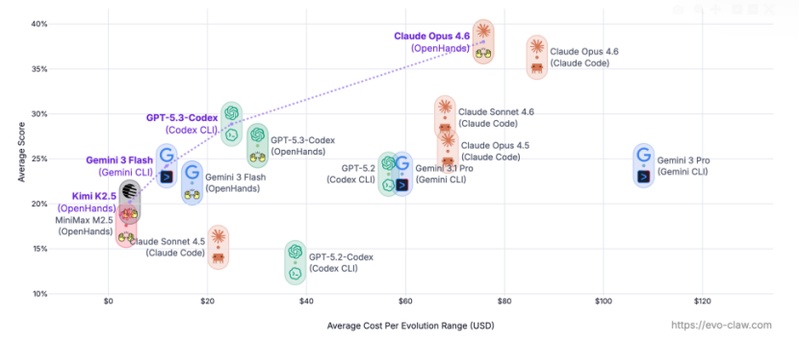

从技术极客视角看,API调用的经济模型正在从单次付费转向服务包模式。通过对比不同套餐的请求限额,我们可以发现,高频次请求的边际成本正在被极度压缩。对于重度依赖Cline或OpenClaw的工程师来说,将算力消耗纳入预算规划,是迈向工程化落地的必经之路。

工程实践:如何通过成本优化提升迭代效率

成本控制不应仅仅是财务行为,更应是工程效率的一部分。当单次请求成本不再是阻碍创新的瓶颈,开发者可以更频繁地进行实验,验证Agent的决策逻辑,从而缩短产品从原型到上线的周期。

利用预付费额度进行压力测试,能够帮助团队更客观地评估模型在实际负载下的性能表现,而非仅依赖基准测试数据。这种数据驱动的评估体系,是构建健壮AI应用的基础。

在资源分配上,建议将计算密集型任务通过路由策略分配给Pro版的高性能模型,而将常规代码补全任务分配给Lite版,这种分层调度策略能实现算力利用率的最大化。